O 1° comercial criado 100% com inteligência artificial.

O primeiro anúncio em vídeo com IA, que comprava o potencial da nova geração e respectiva mudança na maneira de produzir vídeo no setor de publicidade.

A Lift, uma agência de Israel, revelou que seu novo anúncio foi totalmente criado por inteligência artificial. De acordo com o portal brasileiro Update or Die, essa iniciativa não é estritamente inovadora. Experiências anteriores já haviam sido feitas, muitas vezes com um tom satírico, como o falso anúncio de uma empresa fictícia fundada pela ativista Greta Thunberg para derrubar e vender árvores da Amazônia brasileira.

O anúncio da Lift, desenvolvido por Matan Cohen Grumi para uma marca americana de pasta de amendoim, é completamente sério e sinaliza uma era emergente onde a autoria humana ou computacional em comerciais e filmes se tornará indistinguível. Com uma abordagem simples, o vídeo é embalado por música de ópera e apresenta uma sequência de cachorros ansiando pela pasta de amendoim, finalizando com a mensagem de que o produto é “feito para humanos, mas desejado por todos”.

A Importância da Visão Computacional para Monitorar Pessoas que Moram Sozinhas

Viver sozinho pode ser uma experiência libertadora, mas também pode trazer riscos para pessoas que necessitam de acompanhamento devido a condições médicas, idade avançada ou outras circunstâncias. Diante deste cenário, a tecnologia vem sendo cada vez mais considerada como uma aliada potencial. Um projeto piloto em andamento busca oferecer uma solução tecnológica promissora: utilizar visão computacional para monitorar essas pessoas e fornecer assistência quando necessário.

O Projeto Piloto

Este projeto inovador tem o objetivo de utilizar ferramentas de monitoramento de alta tecnologia para pessoas que podem se encontrar sozinhas por diversas razões. Utilizando processadores i5 de sexta geração ou superior, o sistema é capaz de detectar eventos como quedas e acionar ajuda de forma automática.

Entretanto, o objetivo final é ainda mais ambicioso. Os desenvolvedores estão trabalhando para tornar o sistema compatível com dispositivos móveis, Raspberry Pi e outros equipamentos de configuração mais modesta, tornando a tecnologia acessível a um público ainda mais amplo.

Visão Computacional: O Coração do Sistema

A visão computacional é um campo da inteligência artificial que ensina as máquinas a interpretar e entender o mundo visual. Neste projeto, a visão computacional pode fazer muito mais do que apenas detectar quedas. Potencialmente, o sistema poderá identificar comportamentos anormais, monitorar rotinas e até fornecer dados para análises médicas.

Segurança e Privacidade

É claro que o uso de câmeras para monitorar pessoas em suas próprias casas levanta preocupações legítimas sobre privacidade. No entanto, os desenvolvedores do projeto estão focados em garantir que todos os dados sejam seguros e utilizados apenas para o propósito de assistência e cuidado. Além disso, o uso da tecnologia seria totalmente opcional, destinado a quem vê um valor claro na utilização do sistema de monitoramento.

Por que é Importante?

- Autonomia: Este sistema permite que pessoas que normalmente necessitariam de um cuidador possam manter sua independência, sem sacrificar sua segurança.

- Resposta Rápida: No caso de emergências como quedas, o tempo é crucial. O sistema poderia reduzir significativamente o tempo entre o incidente e a chegada da ajuda.

- Acessibilidade: Ao tornar o sistema compatível com hardware mais acessível, a tecnologia poderia ser utilizada por uma parcela maior da população, não apenas por aqueles que podem pagar por sistemas de monitoramento caros.

- Paz de Espírito para Familiares: Saber que seu ente querido está sendo monitorado e que ajuda será acionada imediatamente em caso de emergência é algo inestimável.

Conclusão

Com o envelhecimento da população e o aumento do número de pessoas vivendo sozinhas, soluções como essa são cada vez mais necessárias. O projeto é um excelente exemplo de como a visão computacional pode ser usada para tornar a vida melhor e mais segura para uma grande parcela da sociedade. Estamos aguardando ansiosamente as fases futuras deste projeto inovador.

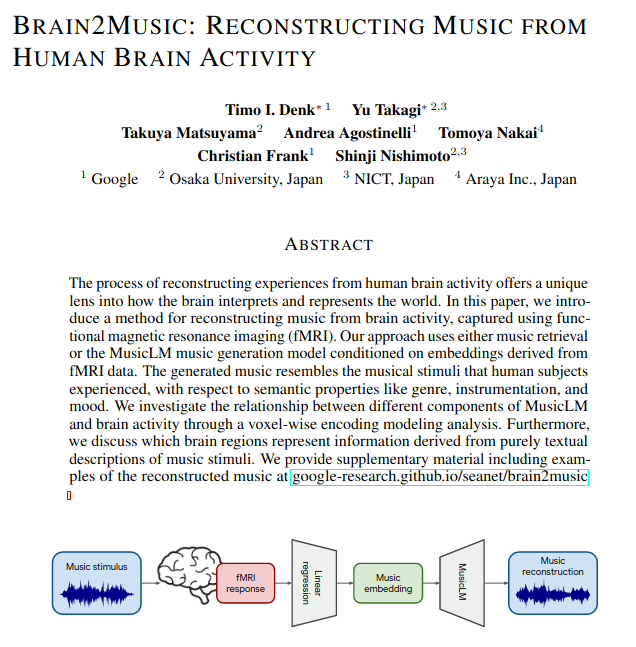

Brain2Music: Reconstruindo Música a partir de atividades cerebrais.

O complexo processo de reconstrução de experiências com base na atividade cerebral humana sempre fascinou cientistas e pesquisadores. Ele desvela uma compreensão singular sobre como nosso cérebro, essa maravilha biológica, decodifica, interpreta e, por fim, representa o universo ao nosso redor. Recentemente, um paper inovador foi publicado, abordando um método pioneiro que se propõe a uma tarefa audaciosa: recriar música a partir dos impulsos e atividades do nosso cérebro.

Um grupo de pesquisadores no Japão, com expertise em neurociência e inteligência artificial, desenvolveu um modelo de IA generativa. Este modelo é capaz de, surpreendentemente, transformar ondas cerebrais, as sutis e complexas sinfonias elétricas de nossos neurônios, em composições musicais. Esta iniciativa revolucionária recebeu o nome de “Brain2Music”. A companhia por trás desta pesquisa, reconhecendo o impacto potencial de suas descobertas, compartilhou entusiasticamente alguns dos resultados preliminares do estudo com a comunidade científica e o público em geral esta semana.

O que torna esta pesquisa ainda mais cativante é a notável precisão do modelo. Ao analisar as faixas de áudio geradas pela inteligência artificial, observa-se uma semelhança com a música original. Para validar e treinar o modelo, clipes musicais de 15 segundos, retirados de um total de 540 músicas e abrangendo dez gêneros diferentes, foram selecionados de forma aleatória. Estes clipes foram então tocados para um grupo de participantes. Enquanto se perdiam na melodia e harmonia desses fragmentos musicais, suas atividades cerebrais eram meticulosamente capturadas e registradas, alimentando o treinamento subsequente do modelo de IA.

A simulação de áudio, ou mais especificamente a reprodução de áudio através de inteligência artificial, está rapidamente emergindo como uma das áreas mais promissoras no vasto universo da tecnologia. Estamos à beira de uma era onde a fusão de neurociência e IA pode redefinir as fronteiras do possível. Com avanços como o “Brain2Music”, podemos nos perguntar: será que, em um futuro não muito distante, seremos capazes de criar sinfonias, melodias e harmonias simplesmente com o poder de nossos pensamentos? Apenas o tempo, a pesquisa e a paixão inabalável pelo desconhecido dirão.

OWASP SP : Primeiro Meetup Virtual de 2023

Nesta quarta-feira, dia 02 de Agosto (quarta feira), a OWASP SP proporcionará o primeiro Meetup com debate de extrema relevância, sendo uma vez que o mundo vive uma crise no contexto de segurança da informação e uma grande transformação tecnológica. Todo dia nos deparamos com um novos vazamentos de dados. Sendo assim, a propagação de conhecimento, proporcionará softwares e sistemas seguros minimizando esta crise.

Faremos um bate papo com o tema: “A Importância da OWASP para os Times de Ataque e Defesa”. Um encontro obrigatório para profissionais de segurança, desenvolvedores, e qualquer pessoa interessada em aprender mais sobre a segurança na web.

Estamos animados em já ter confirmado dois convidados especiais:

Paulo Baldin atualmente é CISO e DPO da STARK BANK. Possui mais de 16 anos de experiência e coordenou/participou de mais de 86 projetos (contabilizando 22 mil horas efetivas) em prevenção a fraudes, segurança da informação, auditoria interna/externa, controles internos, combate a crimes cibernéticos, data analytics e desde 2017 atuando diretamente com proteção de dados e privacidade. Graduado e com quatro Pós-Graduações, possui mais de 51 certificações nas suas áreas de atuação, entre elas CISM, CDPSE, DPO, ISO 27001 LI e CPC-PD.

Ana Paula Tessaro: Ana ou Nana, atua como Engenheira de Segurança na JUSBRASIL. Além disso, possuí doutorado em Tecnologia Nuclear, com foco em sistemas, pelo IPEN/USP. Seu campo de atuação abrange segurança defensiva e inteligência cibernética. Possuí várias publicações de artigos em revistas renomadas como Radiation Physics and Chemistry e Brazilian Journal of Radiation Sciences e segue sua jornada com curiosidade, sempre buscando excelência e inovação.

Jonathan Coradi, é Especialista de Segurança da Informação no Banco Safra atua nas frentes do time de pentest e engajamento de RedTeam diretamente alinhado com o negócio. Possui as certificações CRTO e DCPT, autor da CVE-2022-38350 e amante de busca por falhas.

Será um momento de grande aprendizado e troca de experiências. Prepare-se para ampliar seus conhecimentos e habilidades em segurança da web! A troca de ideias e experiências é um dos alicerces da nossa comunidade, por isso, reserve um espaço na sua agenda para esse encontro!

Visão Computacional ajudando a IA Generativa!

O After Detailer (adetailer) é uma extensão que automatiza o recurso inpainting e muito mais. Isso economiza seu tempo, como também é ótimo para corrigir rapidamente problemas comuns, como rostos distorcidos.

Na imagem gerada, como o rosto é pequeno e a resolução é baixa, não há muitos pixels cobrindo o rosto. O VAE não tem pixels suficientes para gerar uma boa face. Portanto, o rosto é truncado e deformações são geradas.

O After Detailer automatiza esse processo usando um modelo de inferência para o reconhecimento facial, assim detectando o rosto e criando a máscara de pintura automaticamente. A extensão então executa o inpainting apenas com a área mascarada.

https://github.com/Bing-su/adetailer

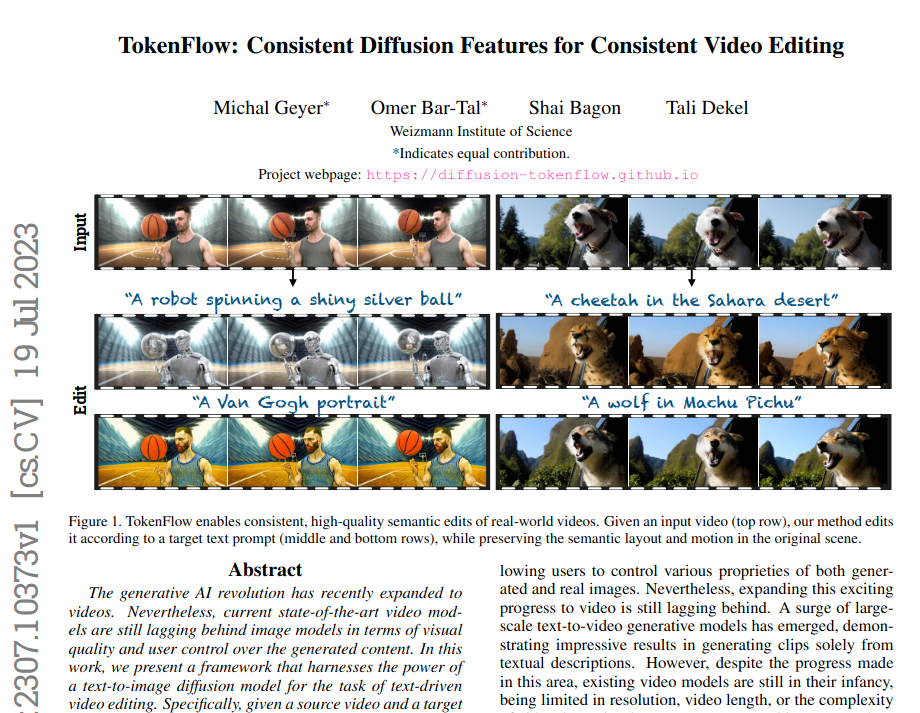

TokenFlow: IA para geração de vídeos.

A inteligência artificial (IA) que cria conteúdo novo, como imagens ou texto, tem se expandido para vídeos. Mas, até agora, os modelos de vídeo ainda não estão no mesmo nível que os de imagem em relação à qualidade visual e à capacidade do usuário de controlar o que é gerado. Neste estudo, foi desenvolvido um sistema que utiliza um tipo especial de IA que converte texto em imagem para editar vídeos baseados em texto.

Basicamente, o sistema pega um vídeo original e um texto guia e cria um vídeo de alta qualidade que segue as instruções do texto. Ao mesmo tempo, ele mantém o arranjo espacial e a dinâmica do vídeo original. A ideia por trás do nosso método é garantir que as características de cada quadro do vídeo sejam consistentes ao longo de toda a edição. Fazemos isso propagando essas características, disponíveis em nosso modelo, de quadro para quadro.

O melhor de tudo é que o sistema não precisa de treinamento ou ajustes específicos. Ele pode ser usado com qualquer método padrão de edição de texto para imagem. Os resultados da edição com nosso sistema em uma série de vídeos reais são impressionantes.

Abaixo o link do paper:

https://arxiv.org/abs/2307.10373

O poder da IA Generativa com openPOSE.

O ControlNet, que vem com a proposta de auxiliar o Stable Diffusion na criação de imagens perfeitas e realistas. ControlNet utiliza esboços, contornos, mapas de profundidade ou normais para orientar os neurônios com base no Stable Diffusion 1.5. Isso implica na possibilidade de se obter imagens quase perfeitas em qualquer modelo personalizado 1.5, desde que se siga a orientação adequada. O ControlNet surge como uma ferramenta revolucionária, proporcionando aos usuários controle total sobre seus projetos.

Para conseguir imagens perfeitas, utilize a extensão A1111 em conjunto com o ControlNet, mais especificamente o módulo Depth. Faça primeiramente alguns closes em selfies e faça upload destas na aba txt2img da interface de usuário do ControlNet. Depois, estabeleça um prompt simples de modelador de sonhos, como “arte de fantasia, homem viking exibindo as mãos em close” e explore o poder do ControlNet. Ao experimentar com o módulo Depth, a extensão A1111 e a aba txt2img da interface de usuário do ControlNet, você obterá mãos visualmente atraentes e realistas.

O ControlNet tem a capacidade de transformar a imagem fornecida em um mapa de profundidade, normais ou esboço, que pode ser usado posteriormente como um modelo. No entanto, também permite que você carregue diretamente seu próprio mapa de profundidade ou esboços. Isso proporciona máxima flexibilidade na criação de uma cena 3D, permitindo que você direcione seu foco para o estilo e a qualidade da imagem final.

A Stable Diffusion é compatível com todos os modelos ControlNet e proporciona um controle significativamente maior sobre a IA generativa. A equipe disponibiliza exemplos de diversas variações de pessoas em posturas estáticas (openPOSE), além de uma variedade de fotos de interiores baseadas no arranjo espacial do modelo e variações de imagens de aves.

Resumindo o futuro chegou!

O pode da IA Generativa com openPOSE.

O ControlNet, que vem com a proposta de auxiliar o Stable Diffusion na criação de imagens perfeitas e realistas. ControlNet utiliza esboços, contornos, mapas de profundidade ou normais para orientar os neurônios com base no Stable Diffusion 1.5. Isso implica na possibilidade de se obter imagens quase perfeitas em qualquer modelo personalizado 1.5, desde que se siga a orientação adequada. O ControlNet surge como uma ferramenta revolucionária, proporcionando aos usuários controle total sobre seus projetos.

Para conseguir imagens perfeitas, utilize a extensão A1111 em conjunto com o ControlNet, mais especificamente o módulo Depth. Faça primeiramente alguns closes em selfies e faça upload destas na aba txt2img da interface de usuário do ControlNet. Depois, estabeleça um prompt simples de modelador de sonhos, como “arte de fantasia, homem viking exibindo as mãos em close” e explore o poder do ControlNet. Ao experimentar com o módulo Depth, a extensão A1111 e a aba txt2img da interface de usuário do ControlNet, você obterá mãos visualmente atraentes e realistas.

O ControlNet tem a capacidade de transformar a imagem fornecida em um mapa de profundidade, normais ou esboço, que pode ser usado posteriormente como um modelo. No entanto, também permite que você carregue diretamente seu próprio mapa de profundidade ou esboços. Isso proporciona máxima flexibilidade na criação de uma cena 3D, permitindo que você direcione seu foco para o estilo e a qualidade da imagem final.

A Stable Diffusion é compatível com todos os modelos ControlNet e proporciona um controle significativamente maior sobre a IA generativa. A equipe disponibiliza exemplos de diversas variações de pessoas em posturas estáticas (openPOSE), além de uma variedade de fotos de interiores baseadas no arranjo espacial do modelo e variações de imagens de aves.

Resumindo o futuro chegou!

Frequência Cardíaca com Webcam

Existe uma uma técnica interessante que permite medir a frequência cardíaca (assim obtendo o número de vezes que seu coração bate por minuto) usando apenas uma câmera de computador. A ideia básica é capturar pequenas mudanças na cor do seu rosto que ocorrem quando o sangue flui através dos vasos sanguíneos a cada batimento do coração.

Quando a luz atinge a pele, parte dela é refletida de volta, e essa luz refletida carrega informações sobre o que encontrou pelo caminho, incluindo o sangue que flui sob a pele. Como diferentes substâncias refletem a luz de maneiras distintas (ou seja, têm diferentes “perfis de reflectância”), podemos usar essas diferenças para identificar e medir coisas específicas, neste caso, os batimentos cardíacos.

Então, essencialmente, esta técnica permite com uma webcam utiliza a reflectância espectral para ‘ver’ o pulso de uma pessoa de uma maneira não invasiva. Ao analisar as mudanças sutis na cor da pele capturadas pela câmera, pode-se calcular a frequência cardíaca. É uma técnica incrível que mostra o quão avançada a ciência e a tecnologia se tornaram!

Abaixo os primeiros resultados das pesquisas iniciada em 2022:

Intel® e Instituto Credicitrus: Nova parceria no ONOVOLAB DE RIBEIRÃO PRETO/SP.

O Instituto Credicitrus e o Credicitrus Innovation Hub acabam de firmar parceria com a renomada empresa de tecnologia INTEL®. A colaboração estratégica resultante desse acordo ocorrerá no Onovolab Powered by Instituto Credicitrus em Ribeirão Preto, SP, e abrirá novos horizontes para a comunidade de empreendedores e desenvolvedores, proporcionando-lhes acesso privilegiado a tecnologias de ponta, como DevCloud, OpenVino e oneAPI. Essas iniciativas serão conduzidas por meio do Intel Innovator, que tem sido certificado com o selo oneAPI desde 2020, e do Intel Insider Council.

Com isto em breve estarei proporcionando para Ribeirão Preto e toda Região do interior de SP, palestras, materiais e informações sobre tecnologias emergentes que envolve Visão Computacional, Inteligencia Artificial e otimização com processadores Intel como programação multi nuclear e primitivas de performance integradas dos processadores.

Mais informações AQUI!

cabelo

cabelo